Así es cómo los ciberdelincuentes aprovechan la IA agéntica en sus actividades

¿Prefieres un resumen de este blog? ¡Da click en el botón de abajo y deja que ChatGPT te lo cuente! (también puedes probar con Perplexity)

Los atacantes no solo aprovechan el poder de las herramientas de IA para perfilar a sus posibles víctimas, afinar el malware o probar distintas vulnerabilidades: ahora también se valen de los agentes de IA.

Un agente de IA es una herramienta capaz de realizar ciertas tareas de forma autónoma: se le pueden establecer objetivos complejos y la herramienta determinará qué tareas debe realizar con ese objetivo, en qué orden y con qué prioridad.

Muchas compañías están usando agentes de IA para establecer estrategias complejas con miras a lograr algún objetivo específico, cómo mejorar el rendimiento financiero, ahorrar en costos en la nube o incluso optimizar los procesos de auditoría.

Sin embargo, en el mundo del crimen su uso está siendo cada vez más extensivo y sofísticado, según lo encontrado en el más reciente informe de ciberseguridad de Anthropic, el Threat Intelligence Report del mes de agosto.

La compañía matriz del asistente Claude revisó en el último mes como los ciberdelincuentes están aprovechando su modelo para optimizar sus ataques desde diversos frentes. Esto fue lo que encontró:

La IA agéntica se ha convertido en un arma. Los modelos de IA ahora se utilizan para llevar a cabo ciberataques sofisticados, no solo para obtener conocimiento sobre cómo llevarlos a cabo.

La IA ha reducido las barreras para cometer delitos cibernéticos sofisticados. Los delincuentes con pocos conocimientos técnicos están utilizando la IA para llevar a cabo operaciones complejas, como el desarrollo de ransomware, que antes habrían requerido años de formación.

Los ciberdelincuentes y los estafadores han integrado la IA en todas las etapas de sus operaciones. Esto incluye la elaboración de perfiles de las víctimas, el análisis de los datos robados, la filtración de información de tarjetas de crédito y la creación de identidades falsas que permiten a las operaciones fraudulentas ampliar su alcance.

Contenido relacionado: El FBI alerta sobre ransomware que aprovecha vulnerabilidades de una herramienta de soporte remoto

«Vibe hacking»: cómo los ciberdelincuentes utilizaron Claude Code para ampliar una operación de extorsión

Una sofisticada red de ciberdelincuentes utilizaba Claude Code para cometer robos y extorsiones de datos personales a gran escala. El autor atacó al menos a 17 organizaciones de diferentes industrias.

En lugar de cifrar la información robada con el ransomware tradicional, el autor amenazó con hacer públicos los datos para intentar extorsionar a las víctimas y que pagaran rescates que en ocasiones superaban los 500 000 dólares.

El delincuente utilizó la inteligencia artificial para automatizar el reconocimiento, la recopilación de las credenciales de las víctimas y la penetración en las redes. A Claude se le permitió tomar decisiones tanto tácticas como estratégicas, como decidir qué datos extraer y cómo elaborar demandas de extorsión dirigidas psicológicamente.

La compañía identificó este uso abusivo de la herramienta, bloqueó las cuentas vinculadas con esta actividad, e introdujo nuevos métodos de identificación de posibles ataques que usen estructuras similares. Además, entregó toda la información a las autoridades correspondientes.

Falsos perfiles desde Corea: el empleo fraudulento con IA

Agentes norcoreanos habrían utilizando Claude para conseguir y mantener de forma fraudulenta puestos de trabajo remotos en empresas tecnológicas estadounidenses (varias incluidas en la lista Fortune 500).

Los modelos de Anthropic fueron usados para crear identidades falsas elaboradas con antecedentes profesionales convincentes, completar evaluaciones técnicas y de codificación durante el proceso de solicitud y realizar trabajos técnicos reales una vez contratados.

Estos planes de empleo estaban diseñados para generar beneficios para el régimen norcoreano, desafiando las sanciones internacionales. Se trata de una operación de larga duración que comenzó antes de la adopción de los LLM y que incluso ha sido denunciada por el FBI.

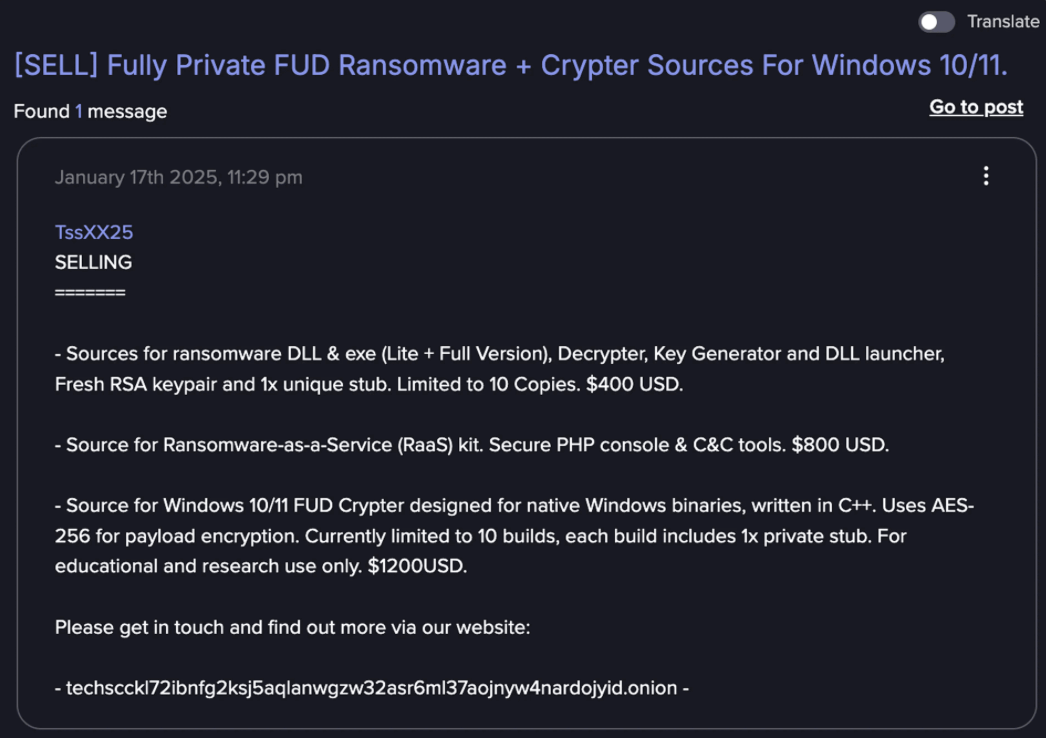

Malware sin código: venta de Ransomware as a Service (RaaS) generado por IA

Un ciberdelincuente utilizó Claude para desarrollar, comercializar y distribuir varias variantes de ransomware, cada una con capacidades avanzadas de evasión, cifrado y mecanismos antirrecuperación.

Estos paquetes de ransomware se vendieron en foros de Internet en la dark web a otros ciberdelincuentes por entre 400 y 1200 dólares estadounidenses, reportando ganancias para los creadores que aprovecharon el potencial de Claude.

Este actor parece haber dependido de la IA para desarrollar malware funcional. Sin la ayuda de Claude, no podrían implementar ni solucionar problemas de componentes básicos del malware, como algoritmos de cifrado, técnicas antianálisis o manipulación interna de Windows.

Oferta de ransomware publicada en la darkweb | Threat Intelligence Report - Anthropic

IA agéntica en ciberseguridad

Cada vez más organizaciones toman conciencia sobre la importancia de incluir funciones de inteligencia artificial en sus sistemas de protección de datos, seguridad informática y ciberseguridad.

Aunque las plataformas de IA como Claude sigan implementando filtros y nutriendo a los modelos para que sean capaces de identificar las malas intenciones de los atacantes, es responsabilidad de empresas y usuarios mantenerse actualizados sobre las tendencias de los actores delictivos.

En este enlace puedes encontrar más detalles de los ataques presentados en esta publicación, así como unas consideraciones adicionales de Anthropic sobre como se frustraron estas actividades.